- Explore MCP Servers

- TizaMcpRag

Tizamcprag

What is Tizamcprag

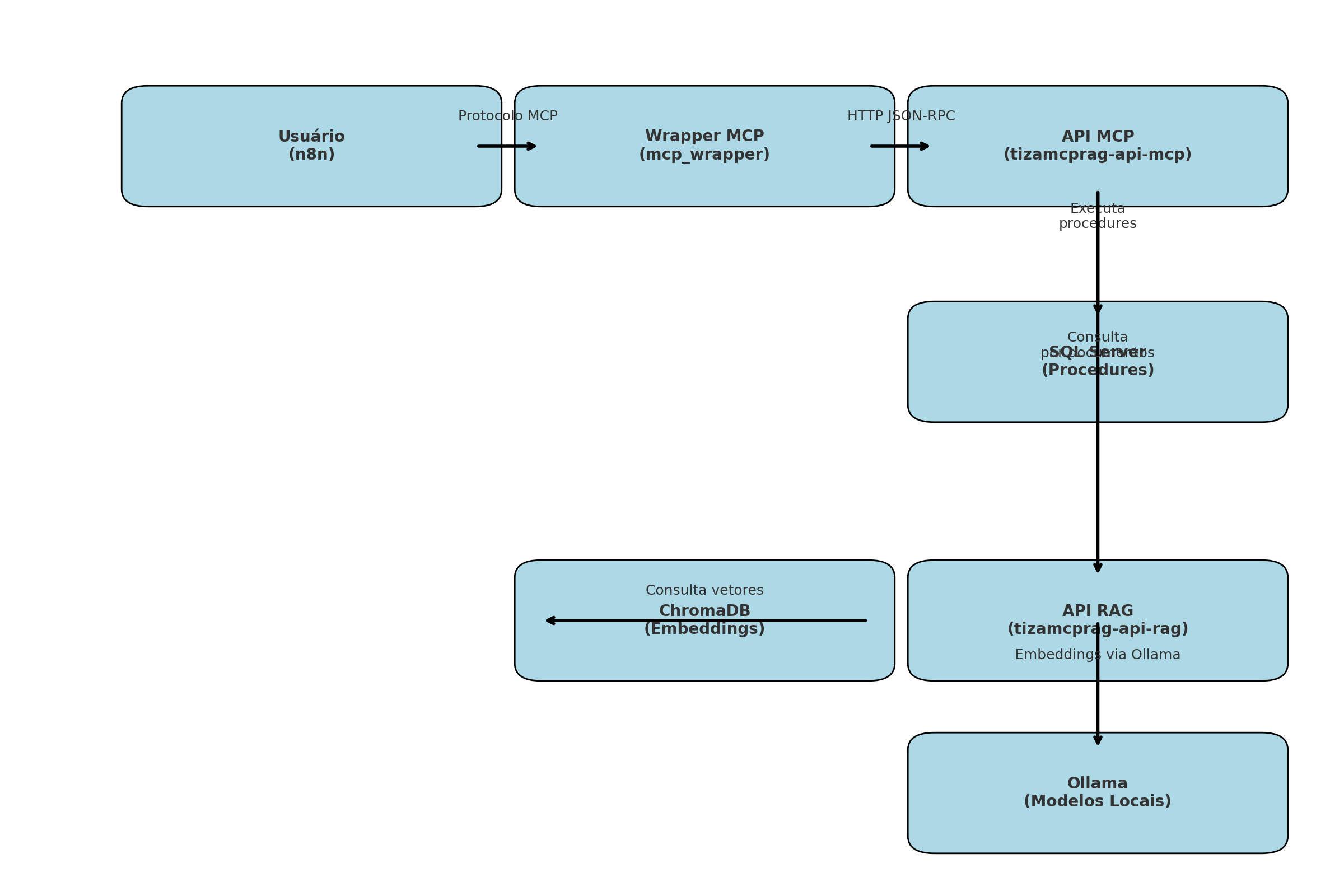

TizaMcpRag is a project that integrates the execution of MCPs (procedures) and RAG (documents) queries using local AI via Ollama.

Use cases

Use cases include automating data workflows, querying documents with AI assistance, executing complex SQL procedures, and integrating local AI into business processes.

How to use

To use TizaMcpRag, set up the environment by copying the example configuration file, editing it with your SQL Server credentials, and running the SQL script to create procedures. Then, start the project using Docker Compose and configure n8n for workflow orchestration.

Key features

Key features include orchestration of workflows with n8n, document querying via api_rag, execution of SQL procedures through api_mcp, and local LLM server support via Ollama.

Where to use

TizaMcpRag can be used in various fields such as data processing, document management, and automation of SQL procedures in environments requiring local AI capabilities.

Clients Supporting MCP

The following are the main client software that supports the Model Context Protocol. Click the link to visit the official website for more information.

Overview

What is Tizamcprag

TizaMcpRag is a project that integrates the execution of MCPs (procedures) and RAG (documents) queries using local AI via Ollama.

Use cases

Use cases include automating data workflows, querying documents with AI assistance, executing complex SQL procedures, and integrating local AI into business processes.

How to use

To use TizaMcpRag, set up the environment by copying the example configuration file, editing it with your SQL Server credentials, and running the SQL script to create procedures. Then, start the project using Docker Compose and configure n8n for workflow orchestration.

Key features

Key features include orchestration of workflows with n8n, document querying via api_rag, execution of SQL procedures through api_mcp, and local LLM server support via Ollama.

Where to use

TizaMcpRag can be used in various fields such as data processing, document management, and automation of SQL procedures in environments requiring local AI capabilities.

Clients Supporting MCP

The following are the main client software that supports the Model Context Protocol. Click the link to visit the official website for more information.

Content

TizaMcpRag

Projeto que integra execução de MCPs (procedures) e consulta RAG (documentos) com IA local via Ollama.

🔥 Fluxograma de Comunicação

Serviços Disponíveis

- n8n: Orquestração de fluxos

- api_rag: Consulta a documentos (RAG)

- api_mcp: Execução de procedures SQL

- ollama: Servidor de LLMs local

Pré-requisitos

Suporte a GPU (Recomendado)

Para melhor performance dos modelos, é recomendado usar GPU. Instale:

- NVIDIA Container Toolkit

- Driver NVIDIA atualizado

Configuração do Banco de Dados

- Copie o arquivo de exemplo de configuração:

cp .env.example .env

- Edite o arquivo

.envcom as credenciais do seu banco SQL Server:

DB_SERVER=seu_servidor DB_DATABASE=seu_banco DB_USERNAME=seu_usuario DB_PASSWORD=sua_senha

- Execute o script de criação das procedures:

# Use seu cliente SQL Server favorito para executar:

sql_server/scripts/create_procedures.sql

Como rodar o projeto

docker-compose up -d

Após iniciar os containers, aguarde alguns minutos para que os modelos do Ollama sejam baixados automaticamente.

Configuração do n8n

Instalação do Node MCP

- Acesse o n8n em

http://localhost:5678 - Vá em Settings > Community Nodes

- Clique em “Add node by providing npm package name”

- Insira

n8n-nodes-mcp - Se a instalação automática falhar, siga os passos para instalação manual:

- Copie a pasta

n8n-nodes-mcppara.n8n/custom - Reinicie o container do n8n

- Copie a pasta

Importação do Fluxo

- No n8n, clique em “Import from File”

- Selecione o arquivo

scripts/TizaChatBot.json - Ajuste as credenciais e endpoints conforme necessário

Atualizando documentos RAG

- Crie a pasta

documentosdentro deapi_rag(caso ainda não exista):

mkdir -p api_rag/documentos

-

Copie os arquivos que deseja indexar para a pasta

api_rag/documentos. -

Execute o comando abaixo para processar os documentos:

docker-compose exec tizamcprag-api-rag python preprocess_docs.py

Modelos do Ollama

O sistema requer os seguintes modelos do Ollama:

nomic-embed-text: para geração de embeddings dos documentosgemma3:latest: para geração de respostas da API RAGmistral: para o agente de chat no n8n (requer suporte a tools)

Para baixar os modelos manualmente, execute os comandos abaixo:

# Baixar modelo de embeddings

docker-compose exec ollama ollama pull nomic-embed-text

# Baixar modelo para respostas RAG

docker-compose exec ollama ollama pull gemma3:latest

# Baixar modelo para agente n8n

docker-compose exec ollama ollama pull mistral

Aguarde o download de cada modelo ser concluído antes de prosseguir. Você pode verificar os modelos instalados com:

docker-compose exec ollama ollama list

Configuração do Agente n8n

Ao importar o fluxo no n8n, configure o nó AI Agent para usar o Ollama:

- Selecione o nó AI Agent

- Em “Service”, escolha “Ollama”

- Configure o endpoint:

http://ollama:11434 - Selecione o modelo

mistral

Observações

- Todos os serviços são gerenciados via

docker-compose.

Dev Tools Supporting MCP

The following are the main code editors that support the Model Context Protocol. Click the link to visit the official website for more information.